Qué modelo de IA elegir en 2026: guía de referencia definitiva para profesionales, pymes y empresas

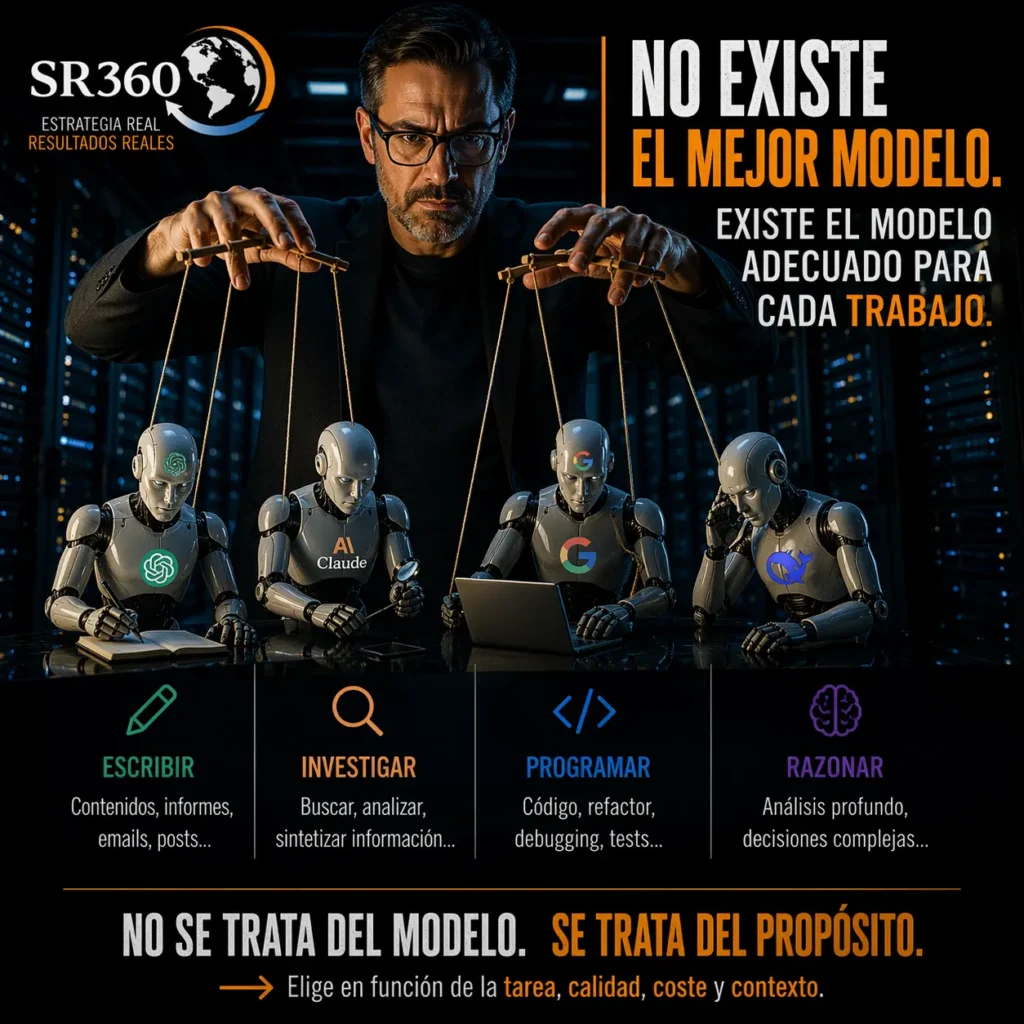

En 2026 ya no tiene sentido preguntar por “el mejor modelo de IA” en abstracto. La decisión correcta depende del tipo de trabajo, del nivel de riesgo, del presupuesto, de la integración con el stack tecnológico y del grado de gobernanza que necesita la organización.

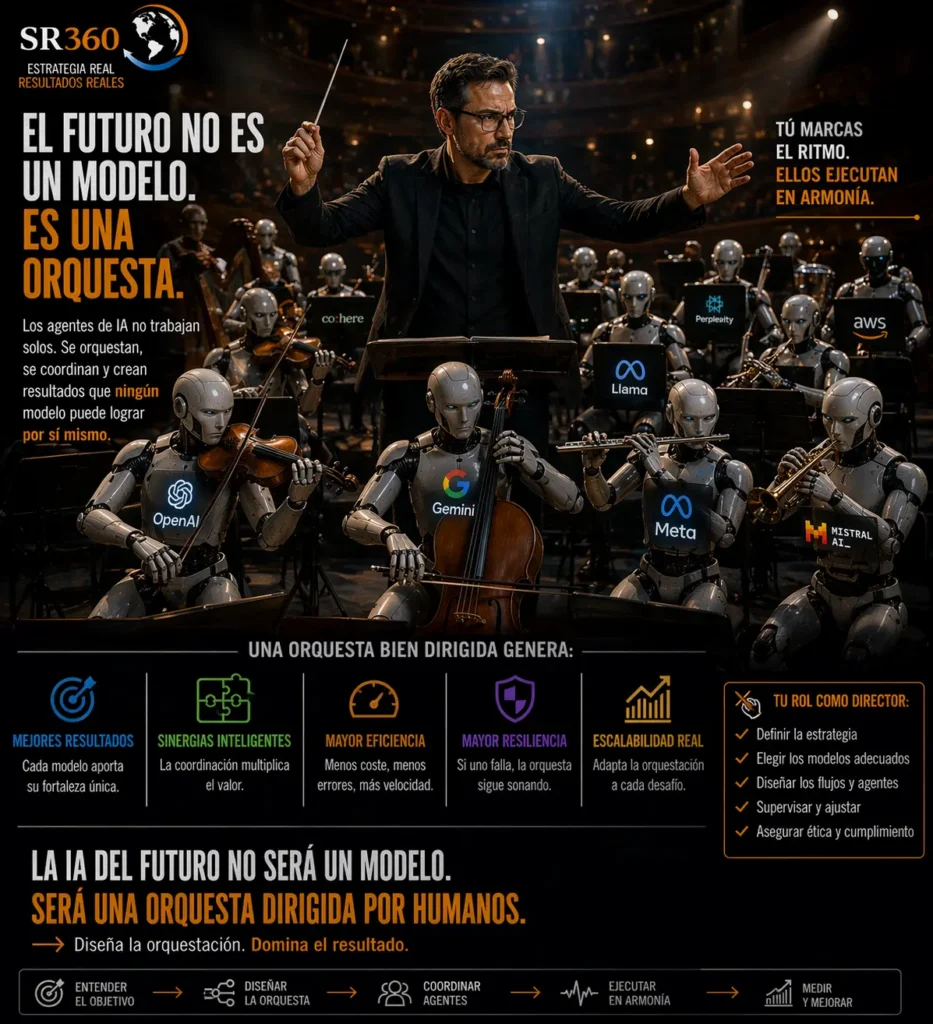

La conclusión central es clara: el mercado ha pasado de la fase del “modelo único” a la fase de los portafolios de modelos. Los equipos más maduros combinan modelos frontier para tareas de alto valor con modelos más baratos, open-weight o especializados para volumen, automatización y despliegue empresarial.

Cómo leer esta guía

Esta guía separa tres niveles de análisis para evitar confundir marketing con realidad:

- Hechos: capacidades confirmadas, documentación oficial, benchmarks reconocidos y marcos regulatorios.

- Benchmarks y señales: resultados en GPQA, MMLU-Pro, LiveBench, LiveCodeBench, SWE-Bench y otros indicadores útiles, con sus límites metodológicos.

- Valoración práctica: qué modelo conviene según tipo de trabajo, riesgo, coste, ecosistema y madurez técnica del usuario o empresa.

La idea clave de 2026

La IA generativa ya no se decide solo por calidad bruta. En 2026 importan al mismo tiempo cinco factores: calidad del modelo, coste de inferencia, integración con herramientas, cumplimiento regulatorio y capacidad de operar en arquitecturas multi-modelo.

Eso cambia completamente el criterio de elección. Un modelo puede ser excelente en benchmark y aun así ser mala elección para una pyme con un único presupuesto de software, o para una empresa que necesita trazabilidad, residencia de datos en la UE y control de costes a escala.

El mercado real en 2026: más ecosistemas que modelos aislados

OpenAI / ChatGPT / GPT-5.x

OpenAI sigue ocupando una posición central en el mercado por calidad general, ecosistema de producto y estandarización de facto en muchos flujos de trabajo profesionales. GPT-5 y GPT-5.1 se presentan como modelos generalistas de referencia para razonamiento, escritura, código y uso multimodal, con integración fuerte vía ChatGPT y Azure OpenAI.

Su gran fortaleza real es el equilibrio: escriben muy bien, programan bien, razonan bien y encajan con relativa facilidad en entornos empresariales. Además, OpenAI ha ampliado la familia con variantes mini/nano y tooling de producción, lo que hace posible combinar calidad alta y costes más contenidos dentro del mismo ecosistema.

Su límite principal no está en capacidad, sino en coste, dependencia y gobernanza. En entornos de alto volumen, usar solo GPT-5.x para todo suele ser económicamente ineficiente frente a diseños con routing y modelos más baratos; además, la dependencia de proveedor y de jurisdicción estadounidense puede ser un problema en ciertos sectores o contratos europeos.

Anthropic Claude

Claude se ha consolidado como la referencia para muchos equipos que priorizan análisis profundo, documentos largos, razonamiento cuidadoso y calidad en programación compleja. Claude 3.7 Sonnet fue un paso importante en esa dirección y las familias Opus/Sonnet posteriores han reforzado esa percepción entre desarrolladores y equipos de conocimiento.

Su fortaleza diferencial es la calidad percibida en tareas largas y sensibles: análisis de contratos, síntesis de documentación compleja, debugging en repos grandes y cumplimiento estricto de instrucciones. En SWE-Bench Verified y HumanEval, Claude figura de forma recurrente entre los líderes o co-líderes, lo que explica su buena reputación en entornos técnicos avanzados.

A cambio, Claude suele ser menos atractivo en coste por volumen y menos natural para organizaciones que ya viven dentro de Microsoft 365 o Google Workspace. En la práctica, muchos equipos lo usan como “modelo premium de criterio” dentro de una arquitectura multi-modelo, más que como motor único para todo.

Google Gemini

Gemini ha reforzado su posición por dos razones distintas: benchmark competitivo y distribución extraordinaria a través de Google Workspace y Google Cloud. En varias tablas de GPQA, MMLU-Pro y LiveCodeBench, Gemini 3 Pro y Gemini Flash aparecen en posiciones de cabeza, lo que desmonta la idea de que solo compite por integración.

Su ventaja más clara en negocio no es solo el modelo, sino el entorno: Docs, Sheets, Slides, Gmail, Drive, Deep Research y Vertex AI. Para muchas pymes y equipos de negocio que ya trabajan en Google, Gemini ofrece el mejor retorno inmediato por fricción reducida, incluso cuando otro modelo supera por poco algún benchmark concreto.

Su principal limitación aparece cuando la organización necesita neutralidad de ecosistema o máxima soberanía. Si el dato vive en Microsoft, en sistemas propios o en varios clouds, el valor diferencial de Gemini baja y obliga a pensar más en arquitectura que en suite ofimática.

DeepSeek

DeepSeek representa el gran cambio estructural del mercado: demuestra que los modelos open-weight y los modelos chinos de alta eficiencia pueden competir de forma muy seria con proveedores propietarios en razonamiento, código y coste por token. DeepSeek V3 y R1 son probablemente el mejor ejemplo de esta ruptura.

Su principal fortaleza es la relación potencia/precio. En coding, análisis técnico y razonamiento cuantitativo, DeepSeek V3.2 y R1 aparecen muy arriba en análisis técnicos y leaderboards, y además permiten despliegues más flexibles o consumo a costes claramente inferiores a los modelos frontier cerrados.

Sus límites reales están en el ecosistema y la operación. Para usuarios no técnicos, DeepSeek no ofrece la experiencia integral de ChatGPT o Gemini; para empresa, exige más criterio arquitectónico, más control de integración y más atención a cumplimiento, soporte y estabilidad del proveedor o del intermediario que lo sirve.

Qwen / Alibaba

Qwen se ha convertido en otra gran señal de que el mercado ya no es solo estadounidense. Qwen2.5-Max y su familia multimodal se han posicionado muy fuerte en Arena-Hard, LiveBench, LiveCodeBench y GPQA-Diamond, con resultados oficiales y técnicos que lo sitúan por encima de DeepSeek V3 en varios cortes.

Su fortaleza es doble: rendimiento técnico alto y un ecosistema cada vez más sólido de modelos multimodales, de largo contexto y de control de interfaces. Esto hace a Qwen especialmente interesante para escenarios con documentos complejos, visión, vídeo y automatización sobre PC o móvil.

El gran freno para muchas empresas europeas no es técnico, sino operativo y geopolítico. La adopción de Qwen depende mucho de la comodidad de la organización con Alibaba Cloud o con proveedores intermedios, además de sus políticas de compliance, soporte y residencia de datos.

Mistral

Mistral ocupa un lugar especial porque es a la vez un actor técnico serio y una pieza estratégica europea. Sus modelos open-weight y comerciales son competitivos en texto, código y despliegue eficiente, aunque normalmente no lideran todos los benchmarks frontier.

Su gran valor no es solo el rendimiento, sino la combinación de calidad suficiente, flexibilidad de despliegue y narrativa de soberanía europea. Para muchas empresas de la UE, Mistral es menos “el mejor modelo del mundo” y más “el modelo razonable para construir IA gobernable en Europa”.

Esto lo vuelve especialmente relevante en arquitecturas híbridas: Mistral para cargas internas, clasificación, RAG, análisis documental de bajo riesgo o entornos on-prem, y modelos frontier externos para los casos de máximo valor o complejidad.

Kimi / Moonshot AI

Kimi es uno de los casos más interesantes de 2025-2026 porque combina coste muy bajo, contexto largo y señales fuertes en programación y agentes. Kimi K2 y K2.5 han ganado visibilidad por benchmarks de código y por su orientación explícita a workflows agentic y multimodales.

Su propuesta es clara: rendimiento cercano a modelos premium en tareas específicas de coding y reasoning con un coste sensiblemente inferior. Esto lo convierte en un candidato muy interesante para desarrolladores avanzados y equipos que quieran experimentar con agentes y pipelines complejos sin disparar presupuesto.

Su límite principal es el mismo que el de otros proveedores emergentes fuera del eje EEUU-UE: soporte, confianza corporativa, percepción regulatoria y fricción de adopción en empresas tradicionales europeas.

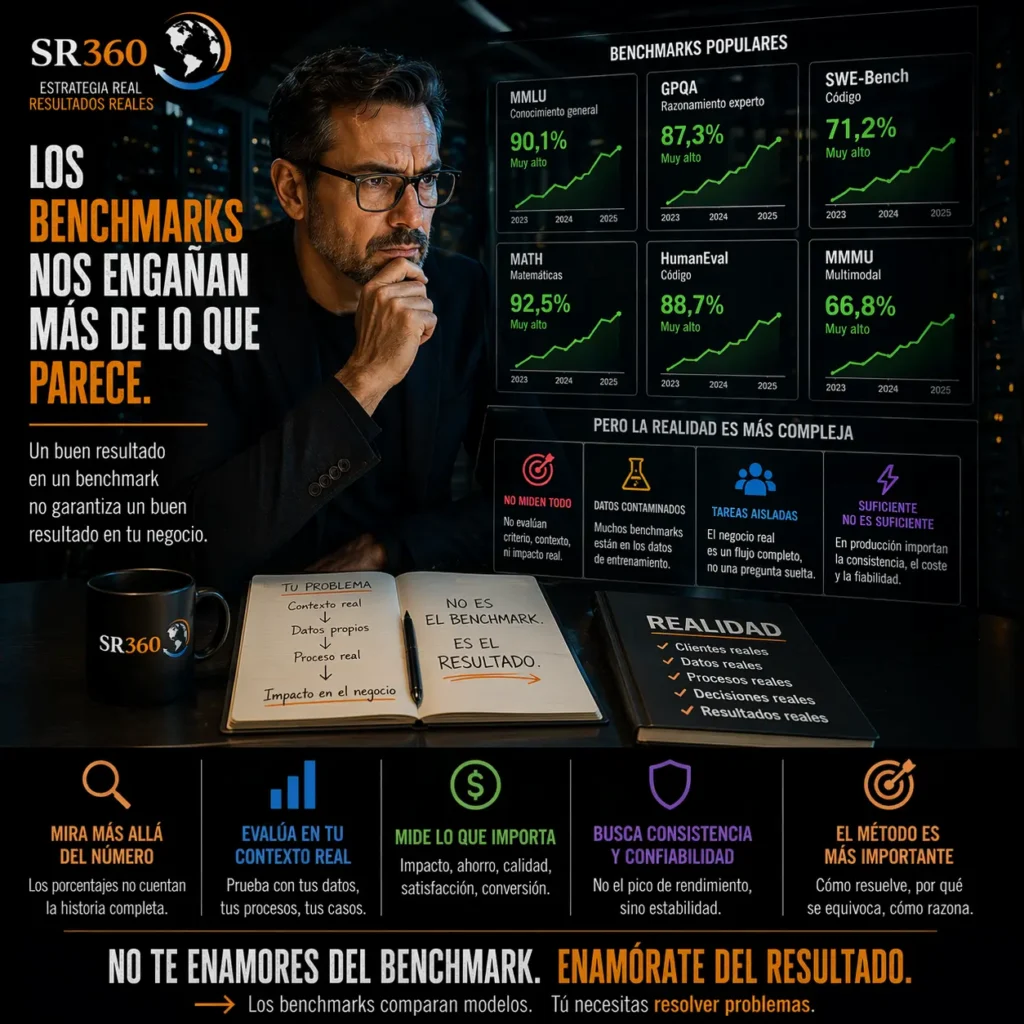

Qué dicen de verdad los benchmarks en 2026

Benchmarks útiles, pero con cuidado

En 2026 los benchmarks siguen siendo necesarios, pero ya no bastan para decidir. Stanford AI Index y varios análisis técnicos insisten en que muchos benchmarks clásicos están cerca de saturación y que las diferencias pequeñas entre modelos top no siempre predicen bien el rendimiento real en producción.

Razonamiento

Para razonamiento académico y técnico, los benchmarks más relevantes hoy son GPQA Diamond, MMLU-Pro, LiveBench, Arena-Hard y AIME en matemáticas. En estas métricas, GPT-5.x, Claude Opus/Sonnet, Gemini Pro y algunos modelos como Kimi Thinking o DeepSeek R1 aparecen en la parte alta, a menudo con diferencias pequeñas y sensibles al protocolo de evaluación.

La lectura correcta no es “quién gana por 1 punto”, sino qué familia de modelos está ya en el grupo de cabeza. En razonamiento general y de negocio, GPT-5.x, Claude y Gemini forman un pelotón muy parejo; DeepSeek y Kimi destacan cuando se prioriza razonamiento técnico o coste; Mistral queda algo más abajo en razonamiento extremo, aunque mantiene buena competitividad general.

Programación

Para programación, los benchmarks más serios en 2026 son LiveCodeBench, SWE-Bench Verified y HumanEval. Aquí la foto es más interesante: Gemini 3 Pro y Flash lideran LiveCodeBench en algunos cortes; Claude brilla mucho en SWE-Bench; GPT-5.x Codex se mantiene arriba de forma muy consistente; DeepSeek, Qwen y Kimi han recortado mucho terreno en coding competitivo y técnico.

La consecuencia práctica es que ya no existe un único ganador universal para código. El modelo ideal depende de si el trabajo es autocompletado diario, arquitectura compleja, debugging de repos reales, generación de tests, coste por volumen o uso intensivo en CLI/IDE.

Documentos largos y contexto

En contexto largo, la cifra de tokens importa menos de lo que sugiere el marketing. Gemini ha destacado por ventanas muy amplias y herramientas de investigación; Claude mantiene una reputación muy fuerte en análisis documental; GPT-5.x es suficientemente robusto para la mayoría de escenarios; Kimi y algunos modelos asiáticos han llamado la atención por contextos 128k-256k y buen rendimiento en código y documentación extensa.

La lectura seria es que, por encima de cierto umbral, la ventaja no viene solo del contexto bruto, sino del sistema completo: chunking, RAG, memoria, citación, observabilidad y calidad del prompting. Un millón de tokens sin arquitectura adecuada puede rendir peor que 128k bien estructurados.

Multimodal

La multimodalidad ha dejado de ser una función ornamental. Stanford AI Index documenta mejoras masivas en benchmarks multimodales exigentes, y la dirección del mercado apunta a modelos capaces de entender texto, imagen, audio, vídeo e interfaces como parte del mismo sistema.

En términos prácticos, Gemini ha capitalizado muy bien esta tendencia en entorno Google; OpenAI mantiene una propuesta muy fuerte entre imagen, voz y vídeo; Qwen y Kimi destacan en flujos más técnicos o experimentales; Mistral y DeepSeek mejoran, aunque hoy no son la primera referencia del mercado en multimodal extremo.

Dónde engañan los benchmarks

Los benchmarks engañan cuando se usan como ranking definitivo en lugar de como mapa parcial. MMLU clásico, GSM8K, HumanEval y otros tests han perdido capacidad de discriminación entre modelos frontier; además, existe riesgo de contaminación de entrenamiento, sobreajuste y diferencias metodológicas entre laboratorios.

También engañan cuando no reflejan latencia, tool use, costes, necesidad de supervisión, robustez ante datos sucios, o comportamiento bajo carga. Un modelo puede rendir espectacular en LiveBench y ser incómodo en producción si falla integrándose con herramientas, cuesta demasiado o tarda demasiado en responder.

La conclusión correcta es que los benchmarks siguen siendo útiles para descartar modelos débiles y para detectar líderes de frontera, pero no sustituyen pruebas internas con tareas reales, datos propios y criterios de negocio.

Qué están usando realmente desarrolladores avanzados

Las señales de comunidades técnicas, documentación de herramientas y comparativas centradas en uso real dibujan una pauta clara. Los desarrolladores avanzados no eligen un solo modelo: usan una combinación de GitHub Copilot, ChatGPT, Claude, Cursor y, en backend, modelos open-weight como DeepSeek, Mistral, Llama o Qwen según el caso.

ChatGPT y GitHub Copilot siguen dominando el volumen de uso, especialmente para preguntas generales, autocompletado y productividad de desarrollo. Sin embargo, Claude ha ganado mucha tracción en análisis de código largo, debugging complejo y trabajo agéntico; Cursor se ha consolidado como interfaz multi-modelo para muchos perfiles senior; y los open-weight se vuelven cada vez más normales en pipelines internos y backends de producto.

Eso confirma una idea importante para cualquier empresa: el mercado real ya funciona en modo multi-modelo, incluso cuando el usuario final solo ve una interfaz. La verdadera competencia ya no es solo entre modelos, sino entre ecosistemas de herramientas, agentes y plataformas de despliegue.

Arquitecturas multi-modelo: el patrón de las empresas maduras

Durante 2025-2026 se ha consolidado una arquitectura dominante en entornos con volumen o complejidad: routing + cascadas + portafolio de modelos. El patrón consiste en usar el modelo más barato que pueda resolver bien la tarea, y escalar a un modelo premium solo cuando la consulta, el riesgo o la complejidad lo justifican.

Qué es model routing

El routing decide qué modelo usar en función de variables como tipo de tarea, longitud del prompt, sensibilidad del dato, necesidad de velocidad, tolerancia al error y coste objetivo. En arquitecturas maduras, un clasificador ligero o un conjunto de reglas decide si una tarea va a GPT-5, Claude, Gemini, DeepSeek, Mistral u otro modelo más económico.

Qué es una cascada barato + premium

La cascada barata + premium usa primero un modelo de bajo coste y solo escala si la confianza es baja, el problema es crítico o el resultado no cumple ciertos criterios. Este patrón se ha vuelto habitual en atención interna, clasificación documental, soporte de empleados y automatización de procesos de backoffice.

Por qué el multi-modelo gana

Las empresas recurren a este patrón por tres razones. Primero, reduce costes de forma significativa; segundo, disminuye lock-in y riesgo de proveedor; tercero, permite ajustar mejor calidad, latencia y cumplimiento a cada tarea.

En volumen medio-alto, usar un único frontier model para todo suele ser una mala decisión económica y operativa. Las fuentes consultadas coinciden en ahorros del 50% al 80% cuando se introducen routing, caching, modelos open-weight y pasos de escalado solo para tareas complejas.

El coste real de la IA en 2026

Una de las ideas más mal entendidas del mercado es que el coste de un modelo se mide solo por precio por token. En realidad, el coste total depende de la suma de licencias, APIs, latencia, errores, tiempo humano, integración, observabilidad, seguridad y mantenimiento.

Suscripciones

Las suscripciones tipo ChatGPT, Copilot o Gemini son muy competitivas cuando el uso es principalmente personal o de equipo y el valor generado por usuario es alto. Para consultores, analistas, abogados, responsables de producto o pequeños equipos, una licencia mensual puede amortizarse enseguida si ahorra unas pocas horas de trabajo de alto valor.

El problema aparece cuando se compran muchas licencias infrautilizadas o se intenta resolver con suscripciones lo que en realidad es un problema de automatización de procesos. En esos casos, la herramienta parece barata por usuario, pero cara frente al valor real capturado.

APIs

Las APIs gestionadas siguen siendo la forma más simple y, en muchísimos casos, la más rentable de empezar. Hasta ciertos volúmenes, pagar por token sigue siendo más barato y mucho menos complejo que desplegar infraestructura propia, especialmente si se combinan varios modelos y se optimiza el routing.

Qué significan realmente los costes por token

Una simplificación frecuente es pensar que el coste de la IA se reduce al precio por token. En la práctica, el token es solo la unidad base de una economía mucho más compleja. Como aproximación, 1.000 tokens equivalen a unas 700–750 palabras; una consulta sencilla puede consumir pocos miles, pero un flujo agéntico con retrieval, herramientas, memoria y validación puede moverse entre 50.000 y 200.000 tokens por tarea. A esa escala, pequeñas diferencias de precio se vuelven relevantes. Un proceso que gestione 10.000 tareas mensuales de 50.000 tokens ya implica cientos de millones de tokens al mes, y ahí una arquitectura mal diseñada puede multiplicar costes innecesariamente si usa modelos frontier para trabajo que podría resolver un modelo más barato vía routing o cascadas.

Por eso muchas organizaciones empiezan a optimizar inferencia, no solo prompting. El debate deja de ser cuánto cuesta un modelo y pasa a ser cuánto cuesta resolver una tarea correctamente. Ese matiz es importante porque el principal coste en muchos sistemas no está en el token, sino en errores, supervisión humana, latencia, reintentos y mantenimiento. De hecho, una automatización aparentemente barata puede salir más cara que un modelo premium si obliga a corregir demasiado. Visto así, el coste relevante deja de ser precio por millón de tokens y pasa a ser coste total por tarea resuelta, que es una lógica mucho más próxima a operación y mucho menos a consumo de API.

Self-hosted open-weight

Los modelos open-weight self-hosted compensan cuando el volumen es alto y estable, cuando la soberanía del dato es crítica o cuando existe capacidad interna para operar infraestructura y ajustar modelos. Sin esos factores, el coste oculto de servidores, MLOps, mantenimiento y seguridad puede superar el ahorro en tokens.

Costes ocultos

Los costes ocultos más relevantes en 2026 son cinco: latencia, alucinaciones, reintentos, supervisión humana y mantenimiento. En muchos entornos críticos, el coste de revisión humana, corrección de errores o refactorización de flujos supera al coste puro del modelo.

AI Act europeo y gobernanza: lo que cambia de verdad

Para pymes y empresas medianas europeas, el AI Act no significa dejar de usar IA generativa. Lo que cambia es la obligación práctica de identificar casos de uso, distinguir niveles de riesgo, documentar proveedores y establecer una mínima gobernanza interna sobre datos, decisiones y responsabilidades.

La regulación no se centra solo en el modelo, sino en el sistema y su uso. Eso significa que no basta con decir “el proveedor cumple”: la empresa que implanta IA sigue siendo responsable de cómo la usa, qué datos introduce, qué decisiones automatiza y qué controles aplica.

Soberanía del dato

La soberanía del dato no es únicamente “tener servidores en Europa”. También implica jurisdicción aplicable, posibilidad de acceso por terceros países, control contractual sobre entrenamiento y reutilización de datos, y capacidad de auditar cómo se procesan los datos sensibles.

Cuándo importa Azure, Bedrock, Vertex o Mistral

Estas plataformas importan cuando la organización necesita residencia de datos, logging, redes privadas, integración con sistemas existentes, auditoría y cumplimiento. Azure OpenAI, Bedrock y Vertex AI son especialmente relevantes cuando la empresa ya vive en uno de esos clouds; Mistral gana importancia cuando la prioridad es combinar calidad suficiente con flexibilidad y soberanía europea.

Errores típicos que se están ignorando

Los errores más frecuentes son no mapear casos de uso, no distinguir niveles de riesgo, depender de un único proveedor, no actualizar contratos con cláusulas de IA, no pedir documentación técnica al proveedor y no formar mínimamente al equipo. Esos errores no suelen generar problemas el primer día, pero sí cuando la IA pasa de experimento a sistema de negocio.

Tendencias creíbles para los próximos 12-24 meses

Las tendencias más sólidas no salen del hype generalista, sino de Stanford AI Index, análisis de hardware, documentación técnica y señales de mercado. Cinco tendencias aparecen como especialmente creíbles para reordenar el mercado en 12-24 meses.

1. Open-weight más fuerte, closed-weight aún dominante en la frontera

El AI Index 2026 muestra que los open-weight se han vuelto mucho más competitivos, aunque los modelos cerrados siguen liderando la frontera. La hipótesis razonable no es que uno elimine al otro, sino que el mercado converja hacia combinaciones híbridas: open-weight para volumen, customización y control; modelos cerrados para frontera, producto y experiencia premium.

2. Agentes como capa de software

McKinsey y a16z coinciden en que la siguiente ola de valor no estará solo en mejores respuestas, sino en sistemas que planifican, ejecutan y coordinan acciones. El paso relevante es de copilotos a agentes, y de agentes aislados a capas completas de software agentic con identidad, permisos, trazabilidad y supervisión.

3. Multimodalidad operativa

La multimodalidad dejará de ser una función llamativa y pasará a integrarse en automatización real: entender pantallas, procesar imágenes de documentos, trabajar con audio, vídeo y entornos visuales para operar procesos. Esto afecta especialmente a retail, industria, salud, operaciones y backoffice visual.

4. Small Language Models especializados

Los modelos pequeños y especializados van a crecer porque el coste de inferencia cae y porque un modelo pequeño bien afinado puede superar a un modelo gigante en tareas muy concretas. La consecuencia práctica es que muchas empresas no tendrán “un gran modelo”, sino un conjunto de modelos pequeños y medianos integrados en productos y flujos específicos.

5. Inference economics

La caída del coste de inferencia continuará desplazando el cuello de botella. Cada vez será menos difícil pagar compute y cada vez más difícil reorganizar procesos, evaluar outputs, garantizar cumplimiento y operar agentes con seguridad y retorno real.

Matriz práctica: qué modelo elegir según tipo de trabajo

La pregunta útil no es “qué modelo es mejor”, sino “qué modelo tiene más sentido si pasa X”. Esta matriz resume el criterio más robusto con la evidencia disponible en 2026.

| Tipo de trabajo | Si pasa X | Entonces elegir Y | Por qué |

|---|---|---|---|

| Escribir | Si quieres una sola herramienta todoterreno | GPT-5.x / ChatGPT | Equilibrio muy alto entre escritura, estructura, tono, análisis y facilidad de uso. |

| Escribir | Si necesitas precisión extrema en instrucciones y texto técnico largo | Claude Sonnet / Opus | Mejor reputación práctica en matiz, detalle y cumplimiento estricto de formato. |

| Investigar | Si trabajas en Google Workspace y necesitas Deep Research | Gemini Pro | Gran integración con Docs, Drive, fuentes y contexto amplio. |

| Investigar | Si priorizas síntesis profunda y criterio analítico | Claude | Muy fuerte en lectura, comparación y análisis largo. |

| Programar | Si quieres calidad máxima en repos complejos y debugging duro | Claude / GPT-5 Codex | Liderazgo sostenido en SWE-Bench, HumanEval y uso real entre devs avanzados. |

| Programar | Si el coste importa mucho y tienes criterio técnico | DeepSeek / Kimi / Qwen | Muy buena relación rendimiento/coste en coding y reasoning técnico. |

| Documentos largos | Si el trabajo es contractual, técnico o de due diligence | Claude | Referencia práctica para análisis documental largo. |

| Agentes | Si buscas calidad y fiabilidad en decisiones | GPT-5.x / Claude como capa fuerte | Buen encaje como cerebro premium dentro de agentes y workflows multi-step. |

| Automatización | Si quieres ahorrar coste en procesos rutinarios | DeepSeek / Mistral / Qwen en capas de volumen | Reducen factura y encajan bien en routing y cascadas. |

| Pyme con una sola licencia | Si ya estás en Google | Gemini | Valor inmediato dentro del stack Workspace. |

| Pyme con una sola licencia | Si quieres la herramienta más versátil | ChatGPT | Mejor equilibrio general si solo vas a pagar una cosa. |

| Empresa con stack multi-modelo | Si tienes variedad de casos y necesidad de gobernanza | Azure/Bedrock/Vertex + frontier model + open-weight barato | Es el patrón más robusto para coste, cumplimiento y resiliencia. |

Cuándo NO elegir un modelo

Elegir bien también implica saber cuándo no usar una opción. OpenAI no es ideal si la prioridad absoluta es soberanía y control local; Claude no es el mejor candidato si el volumen es muy alto y el coste es muy sensible; Gemini pierde fuerza si la empresa no vive en Google; DeepSeek y Qwen no son la opción más cómoda para equipos no técnicos; Mistral no es hoy la opción frontier número uno en razonamiento extremo; Kimi sigue teniendo más fricción corporativa que los líderes establecidos.

Del mismo modo, usar un solo modelo para todos los casos es un error cuando hay alto volumen, necesidades distintas de velocidad y riesgo, o requisitos de soberanía y auditoría. En 2026, la pregunta correcta para una empresa no es “qué modelo compro”, sino “qué cartera de modelos y qué arquitectura me convienen”.

Recomendaciones por tipo de organización

Autónomos y profesionales

Para un profesional que quiere una sola herramienta, la mejor estrategia sigue siendo escoger una plataforma generalista y exprimirla bien. ChatGPT suele ser la opción más versátil; Claude puede ser mejor si el trabajo es más técnico-documental; Gemini tiene mucho sentido si toda la operativa diaria ya está en Google Workspace.

Pymes

La prioridad de una pyme no debería ser perseguir el benchmark más alto, sino capturar valor rápido sin complicar la operación. Normalmente eso significa una herramienta principal para productividad y, si hay automatización, un pequeño stack con uno o dos modelos adicionales y workflows no-code o low-code.

Empresas medianas y grandes

En empresa, el salto importante es pasar de herramientas aisladas a plataforma y gobernanza. Eso implica catálogo de casos de uso, criterios de riesgo, capa de routing, observabilidad, contratos adecuados, control presupuestario y una estrategia multi-modelo alineada con cloud, compliance y unidad de negocio.

Cómo construir una estrategia sensata en 2026

La estrategia más sólida hoy tiene seis pasos. Primero, clasificar los tipos de trabajo: escritura, análisis, código, documentos, automatización y tareas sensibles. Segundo, asignar un modelo principal a cada bloque. Tercero, definir qué tareas requieren modelo premium y cuáles pueden bajar a un modelo barato. Cuarto, medir calidad y coste en pruebas internas. Quinto, documentar proveedores, riesgos y datos. Sexto, revisar la cartera trimestralmente, porque el mercado sigue moviéndose rápido.

Esto evita dos errores muy comunes: sobregastar en un frontier model para tareas triviales y subestimar el coste de gobernar IA en producción. La combinación correcta no es la más llamativa, sino la que alinea calidad, coste, cumplimiento y velocidad de adopción.

Cinco errores que conviene evitar

- Elegir por benchmark y no por caso de uso.

- Sobredimensionar frontier models para tareas rutinarias.

- Confundir pilotos con arquitectura.

- Ignorar costes ocultos (latencia, supervisión, errores).

- Diseñar IA sin pensar en gobernanza y dependencia de proveedor.

La gran conclusión

En 2026 no gana el proveedor con el mejor eslogan ni el benchmark más vistoso. Ganan las organizaciones que entienden qué tipo de trabajo hacen, qué riesgo asumen, cuánto pueden pagar y qué arquitectura necesitan para combinar modelos, datos y procesos con criterio.

La decisión correcta casi nunca es binaria. Para la mayoría de profesionales, pymes y empresas, el camino más inteligente es construir un sistema escalonado: una herramienta principal para productividad, una segunda capa para automatización o trabajo técnico, y una lógica de gobernanza que permita crecer sin depender ciegamente de un único modelo o proveedor.

Cuando la IA sea abundante, el criterio será premium. Ahí empieza la ventaja competitiva.

Nota metodológica

Este artículo integra investigación técnica, documentación de proveedores frontier y open-weight, análisis de costes de inferencia, marcos regulatorios, benchmarks académicos y literatura emergente sobre agentes y arquitectura multimodelo. Se han priorizado fuentes primarias y documentación técnica frente a contenido divulgativo.

Fuentes principales consultadas

- Stanford AI Index Report.

- OpenAI Platform Documentation.

- Anthropic Documentation.

- Google Vertex AI Documentation.

- AWS Bedrock Documentation.

- Azure OpenAI Documentation.

- Mistral Technical Documentation.

- DeepSeek Technical Papers.

- Qwen Documentation.

- Texto oficial AI Act Unión Europea.

- GDPR y documentación EDPB.

- McKinsey research on Agentic AI.