La inteligencia artificial en el trabajo en España ya está regulada: el problema no es la ley, es cómo se está aplicando

La inteligencia artificial ya está entrando en la gestión de empleados en España, pero no lo está haciendo como suele contarse en titulares o presentaciones comerciales. En la práctica, la mayoría de empresas no han desplegado “IA autónoma” que contrate, despida o gobierne por sí sola, sino una mezcla de algoritmos, analítica, motores de optimización, software de planificación, dashboards de productividad, monitorización digital y, cada vez más, herramientas de IA generativa integradas en flujos de RRHH, operaciones y supervisión.

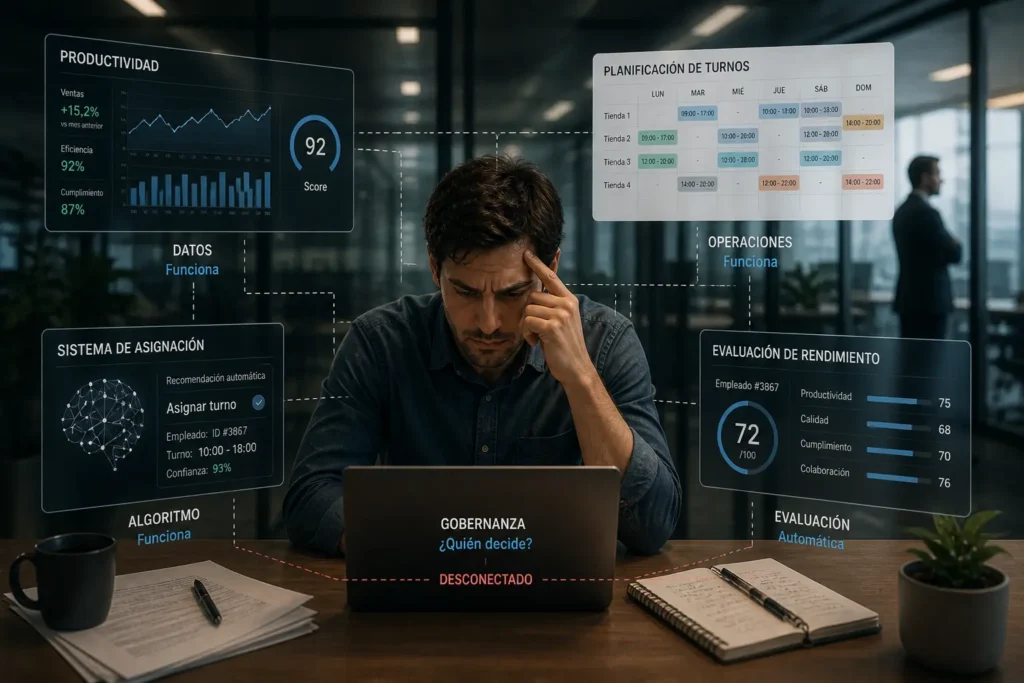

Ese uso real ya está generando un problema evidente: la empresa española está adoptando tecnología de gestión algorítmica más rápido de lo que está construyendo transparencia, control humano, evaluación de riesgos y gobernanza laboral seria. El resultado no es una ausencia total de regulación, sino un marco fragmentado, reactivo y todavía insuficientemente aterrizado para el uso real de IA en turnos, productividad, evaluación, vigilancia y organización del trabajo.

No existe una “ley española de IA laboral” cerrada

Hoy no existe en España una ley unificada y autosuficiente que regule de principio a fin la inteligencia artificial en el ámbito laboral. Lo que existe es un ecosistema normativo compuesto por piezas distintas que se cruzan entre sí:

- El Reglamento europeo de IA (AI Act), que trata como de alto riesgo muchos sistemas de IA utilizados en empleo, selección, promoción, evaluación o gestión de trabajadores.

- El RGPD y la LOPDGDD, que regulan la base legal del tratamiento, la transparencia, la elaboración de perfiles, la evaluación de impacto y los límites a las decisiones automatizadas.

- El Estatuto de los Trabajadores, especialmente el artículo 64.4.d introducido por la Ley Rider, que obliga a informar a la representación legal sobre los parámetros, reglas e instrucciones de los algoritmos o sistemas de IA que afectan a condiciones de trabajo, acceso y mantenimiento del empleo o elaboración de perfiles.

- La normativa de prevención de riesgos laborales, que obliga a evaluar también los riesgos psicosociales derivados de la digitalización, la vigilancia constante y la pérdida de autonomía.

- La normativa sobre control empresarial y derechos digitales, que condiciona videovigilancia, geolocalización, uso de dispositivos digitales, control horario y monitorización del trabajador.

Esta arquitectura jurídica tiene una consecuencia importante: la empresa que implanta IA en gestión de personas no puede pensar en una única norma, sino en un rompecabezas de obligaciones técnicas, laborales, organizativas y de protección de datos. Y ese es precisamente uno de los grandes problemas actuales: el uso real de estas soluciones en empresa va mucho más rápido que la madurez del cumplimiento interno.

La Ley Rider fue mucho más que una norma para repartidores

La llamada Ley Rider suele leerse como una norma dirigida al reparto en plataformas, pero su alcance real es mayor. La reforma del artículo 64 del Estatuto de los Trabajadores introdujo una obligación de información algorítmica que no se limita a riders: afecta a cualquier empresa que use algoritmos o sistemas de IA para tomar decisiones que incidan en condiciones de trabajo, acceso o mantenimiento del empleo o elaboración de perfiles.

Ese punto es crucial porque convierte algo que hasta hace poco se gestionaba como una cuestión puramente tecnológica o de proveedor en una obligación laboral directa frente a la representación legal de los trabajadores. Ya no basta con decir “el software calcula los turnos” o “la plataforma asigna automáticamente”; la empresa tiene que poder explicar qué datos utiliza, qué variables pondera, cómo influye en la jornada, los incentivos, la evaluación o el acceso al trabajo y qué margen real de revisión humana existe.

La guía del Ministerio de Trabajo sobre información algorítmica, aunque no es una ley, ha sido decisiva para aterrizar esta obligación. Su planteamiento es claro: si un algoritmo organiza, vigila, asigna, evalúa, sanciona o condiciona ingresos y empleo, debe ser explicable en términos comprensibles y útiles para el control colectivo.

Cómo están usando de verdad estas soluciones las empresas en España

La imagen de una IA todopoderosa gestionando toda la plantilla sigue siendo más marketing que realidad. Lo que se está implantando de verdad en España son cuatro grandes familias de soluciones.

1. Planificación “inteligente” de turnos y cobertura

Retail, hostelería, restauración organizada, logística y servicios con fuerte componente operativo están desplegando herramientas de workforce management que predicen demanda por franja horaria y recomiendan cuadrantes óptimos combinando históricos de ventas, afluencia, estacionalidad, disponibilidad, convenios, contratos y descansos.

En este punto conviene desmontar un mito: muchas de estas soluciones se venden como IA avanzada, pero en realidad su núcleo es optimización matemática, analítica predictiva relativamente acotada y reglas de negocio. Son herramientas muy útiles, sí, pero su eficacia y su justicia dependen menos de una supuesta “inteligencia” autónoma que de cómo se parametrizan los objetivos y restricciones.

En una cadena de retail, por ejemplo, el sistema puede proponer qué número de personas necesita cada tienda por hora según tráfico esperado, campañas, meteorología o históricos comerciales. En restauración o fast food, estas herramientas ya se utilizan para casar picos de demanda, reparto de tareas, cobertura mínima y coste laboral por tramo horario.

2. Dashboards de productividad y rendimiento

La segunda capa de implantación real son los cuadros de mando de productividad. En retail se cruzan ventas por hora, conversión, ticket medio y cobertura de personal; en logística se miden tiempos por pedido, errores, devoluciones o productividad por ruta; en servicios se siguen tickets resueltos, llamadas, tiempos de respuesta o indicadores de actividad en sistemas corporativos.

Aquí aparece uno de los desajustes más serios entre discurso y práctica. Muchas empresas hablan de “IA para evaluar desempeño”, cuando en realidad lo que usan es BI, analítica descriptiva y reglas que convierten determinados KPI en scores internos. El problema no es semántico: al revestir de IA una simple arquitectura de indicadores, las decisiones empresariales pueden parecer más objetivas o neutrales de lo que realmente son.

3. Vigilancia y control digital

La tercera familia es la más sensible jurídicamente: videovigilancia, geolocalización, registro horario digital, monitorización de dispositivos, análisis de actividad en ordenadores, capturas de pantalla, puntuaciones internas o trazas de comportamiento en herramientas de trabajo.

Estas tecnologías ya no se usan solo para seguridad o cumplimiento horario. En muchas organizaciones forman parte del ecosistema con el que se vigila productividad, disciplina, tiempo efectivo, cumplimiento de objetivos o “engagement” operativo. Y cuanto más se aproxima un sistema a medir de forma continua el comportamiento laboral individual, más se activa el núcleo duro del conflicto legal: proporcionalidad, transparencia, finalidad y supervisión humana.

4. IA generativa y automatización asistida en RRHH

La cuarta ola es la IA generativa. En España ya se está usando en RRHH y en mandos intermedios para redactar descripciones de puesto, resumir entrevistas, preparar evaluaciones, sintetizar encuestas de clima, redactar comunicaciones internas o apoyar procesos de formación y atención interna.

Sin embargo, incluso aquí conviene distinguir entre relato y realidad. En muchas empresas no existe una “IA de RRHH” plenamente integrada, sino un uso disperso y oportunista de asistentes generativos por parte de profesionales concretos o integraciones parciales dentro de suites y plataformas. Es decir: menos automatización robusta de decisiones y más ofimática aumentada.

El gran desfase: lo que se vende como IA frente a lo que realmente se aplica

Uno de los errores más habituales en el debate empresarial español es hablar de IA como si todo lo automatizado lo fuera. En la práctica, muchas de las herramientas implantadas en gestión de empleados son combinaciones de reglas, scoring, modelos predictivos simples, optimización matemática y cuadros de mando.

Ese desfase importa por cuatro razones.

La primera, porque genera falsas expectativas de precisión. Se presenta como “objetivo” lo que en realidad depende de criterios humanos: qué KPI se selecciona, qué peso recibe cada variable, qué se entiende por productividad y qué umbrales activan decisiones.

La segunda, porque traslada responsabilidad al software. Cuando un responsable dice “lo ha decidido el algoritmo”, a menudo está ocultando una elección de parametrización previa que sigue siendo enteramente empresarial.

La tercera, porque rebaja la exigencia interna de control. Al tratar un sistema como una “caja inteligente” suministrada por un proveedor, muchas compañías dejan de documentar adecuadamente el tratamiento, los sesgos, las limitaciones y los efectos reales sobre las personas trabajadoras.

La cuarta, porque empeora el conflicto laboral. Si la plantilla percibe que la app, el cuadrante o el dashboard operan como un poder invisible e inexplicable, la sensación de arbitrariedad aumenta incluso cuando el sistema mejora técnicamente la planificación.

Dónde falla más la implantación en la práctica

Lo que está fallando en España no es solo la norma, sino la manera en que muchas empresas están aterrizando estas herramientas.

1. Se implantan como proyecto de operaciones, no como proyecto laboral

En retail, hostelería, logística o servicios, los sistemas de turnos, scoring y productividad suelen desplegarse desde operaciones, IT o proveedor, con participación tardía o mínima de laboral, protección de datos y PRL. Ese error de diseño es estructural, porque el impacto real del sistema no es sólo operativo: afecta a jornada, incentivos, carga mental, salud, clima y relaciones colectivas.

2. Se optimiza coste antes que sostenibilidad laboral

Muchos motores de planificación funcionan bien si el único objetivo es casar demanda y coste. El problema aparece cuando esa lógica se aplica sin introducir restricciones robustas de fatiga, equidad interna, estabilidad de horarios, descansos suficientes, rotación equilibrada o conciliación.

En términos legales, un cuadrante puede ser formalmente válido y a la vez profundamente agresivo desde la perspectiva de salud mental o clima laboral. Esa es una de las grandes zonas grises de la gestión algorítmica actual: cumple sobre el papel, erosiona en la práctica.

3. No se explica de verdad a plantilla ni a representantes

La transparencia sigue siendo uno de los puntos más débiles. Las empresas informan de que “hay una herramienta” o de que “se usa IA para mejorar la productividad”, pero a menudo no explican qué datos alimentan el sistema, cómo se ponderan, qué consecuencias puede tener para la jornada, la evaluación o el salario variable, ni qué margen real existe para revisar un resultado.

Ese déficit no es sólo reputacional. Puede convertirse en incumplimiento del RGPD, del ET y de la obligación específica de información algorítmica introducida por la Ley Rider.

4. Se olvida la prevención de riesgos psicosociales

Este es probablemente el fallo más subestimado. La digitalización y la IA están entrando en el trabajo con una promesa de eficiencia, pero también con efectos claros en carga mental, estrés, vigilancia constante, presión por indicadores y pérdida de autonomía.

El INSST y materiales sindicales y académicos vienen advirtiendo que la combinación de alta exigencia, bajo control y monitorización continua agrava riesgos psicosociales clásicos y crea otros nuevos. Sin embargo, muchas implantaciones siguen sin incorporar una evaluación específica de estos riesgos antes de desplegar dashboards, scoring o control digital intensivo.

Lo que exige realmente el RGPD cuando la IA se aplica a empleados

El RGPD no prohíbe la IA en empresa, pero obliga a encajarla dentro de reglas muy exigentes cuando trata datos de empleados o candidatos.

Base legal

La empresa necesita una base jurídica clara para el tratamiento. En entorno laboral, el consentimiento suele ser una base débil por la asimetría de poder, por lo que la mayoría de usos reales se apoyan en interés legítimo, necesidad contractual o cumplimiento de obligación legal, siempre con pruebas de proporcionalidad y necesidad.

Transparencia reforzada

Si existe elaboración de perfiles o decisiones automatizadas, la organización debe informar de forma comprensible sobre la lógica aplicada, la relevancia del sistema y las consecuencias previstas del tratamiento. Una cláusula genérica en una política de privacidad no basta para un sistema que puntúa, clasifica, prioriza o condiciona decisiones laborales relevantes.

Evaluación de impacto (DPIA)

Muchos sistemas de IA o scoring sobre empleados requieren evaluación de impacto en protección de datos, especialmente si existe monitorización sistemática, elaboración de perfiles, uso de tecnologías innovadoras o decisiones con efectos significativos. En la práctica, este paso se omite con demasiada frecuencia, sobre todo cuando se implanta software estándar adquirido a terceros.

Limitaciones a las decisiones automatizadas

El artículo 22 del RGPD limita las decisiones basadas únicamente en tratamiento automatizado que produzcan efectos jurídicos o afecten significativamente de modo similar a la persona. En empresa esto impacta de lleno sobre selección, promociones, asignaciones penalizantes, bonus, sanciones o despidos si el sistema opera sin revisión humana real.

Aquí aparece otra trampa habitual: se presenta el proceso como “asistido por humano”, pero en la práctica el responsable sólo valida lo que propone la herramienta. Si la intervención humana es puramente formal, el sistema puede seguir considerándose sustancialmente automatizado.

Vigilancia digital: legalidad sí, barra libre no

Las empresas en España sí pueden utilizar sistemas de vigilancia y control digital sobre empleados, pero no sin límites. La combinación ET + LOPDGDD + RGPD + jurisprudencia exige finalidad legítima, proporcionalidad, información previa y respeto a la intimidad y dignidad de la persona trabajadora.

Esto significa, por ejemplo, que pueden utilizarse cámaras para seguridad o control, sistemas de geolocalización para actividades donde sean necesarios, control horario digital o monitorización limitada de dispositivos profesionales. Pero no se admite sin más una vigilancia omnipresente, continua e indiscriminada, ni cámaras en zonas especialmente sensibles, ni rastreo fuera de jornada, ni software invasivo sin justificación fuerte.

El problema de mercado es que muchas soluciones se comercializan con una lógica de “visibilidad total” sobre el empleado, cuando el derecho español sigue construyéndose alrededor de una idea opuesta: el control empresarial existe, pero debe ser necesario, proporcionado y explicable.

Casos reales: qué está ocurriendo cuando las empresas se pasan

Entre 2023 y 2026 ya hay actuaciones reales en España que muestran por dónde van las autoridades. Aunque todavía no existe una enorme masa de jurisprudencia “estrella”, sí se observan patrones claros en AEPD, Inspección de Trabajo y doctrinas judiciales y académicas.

Se han descrito expedientes de la AEPD contra empresas por usar software de productividad extremadamente intrusivo, con monitorización en tiempo real, capturas periódicas de pantalla, puntuaciones automáticas de rendimiento y ausencia de información adecuada o de evaluación de impacto. También se han reseñado casos de IA biométrica y análisis de emociones en selección sin base legal suficiente ni garantías reforzadas, con exigencia de retirar o rediseñar el sistema.

Paralelamente, la Inspección de Trabajo ha puesto el foco en algoritmos utilizados por grandes empresas para turnos, productividad, incentivos o sanciones, pidiendo documentación sobre finalidad, datos usados, criterios, impacto y cumplimiento del deber de información del artículo 64.4.d ET. El mensaje es inequívoco: el secreto empresarial no permite ocultar la lógica relevante cuando esa lógica afecta a derechos laborales.

El impacto más serio no es técnico: es organizativo y psicosocial

El debate sobre IA laboral suele centrarse en privacidad o automatización, pero el efecto más profundo puede estar en la organización del trabajo. Cuando una empresa introduce cuadrantes inteligentes, scoring continuo, dashboards en tiempo real o sistemas de seguimiento granular, cambia la forma en que se vive el trabajo.

Los riesgos psicosociales son especialmente importantes en entornos como retail, hostelería, logística o contact center, donde la presión por picos, cobertura, velocidad y atención al cliente ya era alta antes de la capa algorítmica. Si además se añade una monitorización constante y una reducción del margen de autonomía, el modelo tiende hacia una combinación muy delicada: altas exigencias y bajo control.

Por eso la conversación correcta no es solo “si la IA cumple la ley”, sino “qué tipo de trabajo está produciendo”. Una empresa puede automatizar bien técnicamente y fracasar laboralmente si convierte la organización en un ecosistema de presión permanente, microgestión digital y opacidad.

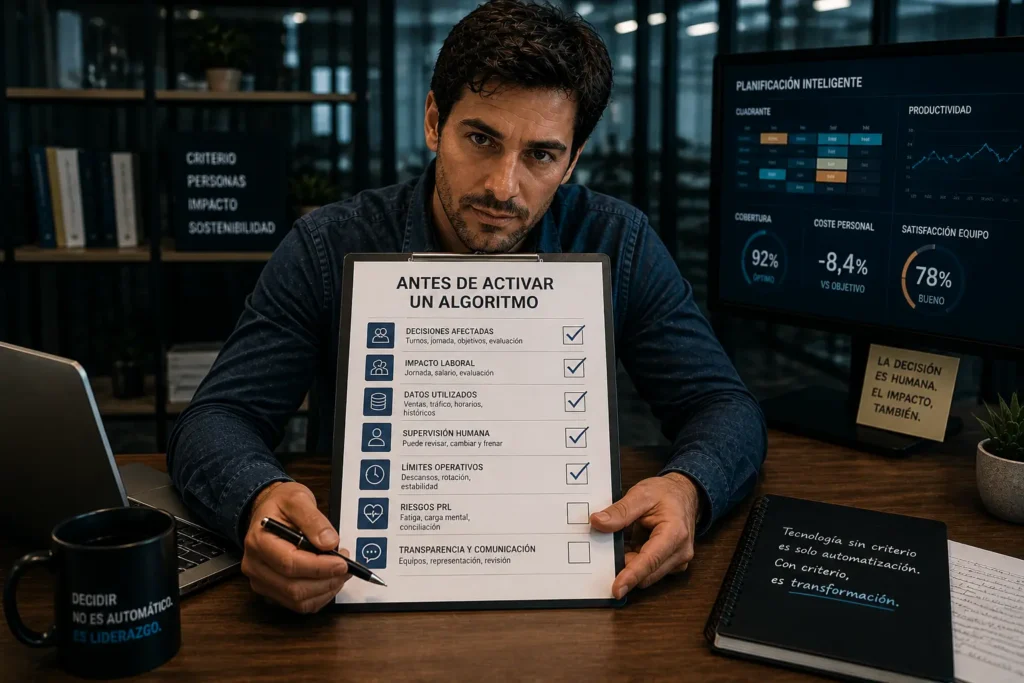

Qué deberían hacer ahora las empresas que quieran usar IA sin abrir un problema laboral

El uso responsable de IA en la gestión de empleados no empieza con la compra del software, sino con un rediseño serio de gobierno interno. A la vista del marco actual y de los problemas que ya se están viendo, hay siete decisiones que separan una implantación madura de una fuente de conflicto.

1. Mapear sistemas y decisiones reales

No basta con inventariar “herramientas con IA”. Hay que identificar qué sistemas planifican, puntúan, vigilan, recomiendan, filtran o condicionan decisiones laborales y qué efectos concretos producen sobre jornada, salario, incentivos, promoción, disciplina o permanencia.

2. Distinguir automatización, analítica e IA real

Separar reglas, dashboards, optimización matemática, machine learning e IA generativa ayuda a gobernar mejor y a no sobrerrepresentar la autonomía del sistema. Muchas compañías necesitan menos “estrategia de IA” y más claridad técnica sobre qué hace realmente cada solución.

3. Someter la implantación a laboral, privacidad y PRL desde el inicio

Turnos, scoring y control digital no son solo tecnología. Deben revisarse con RRHH laboral, protección de datos, PRL y, cuando proceda, representación de los trabajadores, antes del despliegue y no cuando estalla el conflicto.

4. Hacer transparencia útil, no cosmética

La información a plantilla y representantes debe explicar variables, lógica, finalidades, efectos y vías de revisión de forma inteligible. Si una empresa no puede explicar bien el sistema, probablemente tampoco lo controla bien.

5. Introducir supervisión humana real

La supervisión humana no puede ser una firma al final del proceso. Debe existir capacidad efectiva de revisar, corregir, excepcionar y desactivar decisiones propuestas por el sistema.

6. Medir impacto psicosocial y no sólo eficiencia

Un proyecto de cuadrantes inteligentes o scoring de productividad debería incluir métricas de estabilidad horaria, rotación, absentismo, quejas, fatiga, clima y sobrecarga, no sólo coste por hora o cobertura.

7. Negociar más y litigar menos

La negociación colectiva puede convertirse en el instrumento que más ayude a cerrar el hueco entre ley y práctica. Las cláusulas sobre algoritmos, monitorización, revisión humana, límites de uso de datos y participación sindical son hoy una de las vías más útiles para aterrizar reglas en sectores concretos.

Lo que viene: más regulación europea, más exigencia española y menos excusas

La tendencia de fondo es clara. El AI Act va a endurecer exigencias sobre sistemas de alto riesgo en empleo; el RGPD seguirá siendo la gran palanca sobre transparencia, perfilado y decisiones automatizadas; y el derecho laboral español continuará empujando hacia una mayor explicabilidad de la gestión algorítmica.

Eso significa que la fase de “probar herramientas y ya veremos luego el encaje” se está cerrando. En retail, hostelería, logística, servicios y plataformas, la ventaja competitiva no va a venir sólo de usar más IA, sino de usarla con más criterio, más trazabilidad y menos arrogancia tecnológica.

La empresa que entienda esto antes no sólo reducirá riesgo sancionador. También tendrá una ventaja operativa real: cuadrantes más sostenibles, menor conflicto, mejor aceptación interna, menos opacidad y decisiones más defendibles frente a trabajadores, sindicatos, inspección y autoridades de datos.

Fuentes consultadas

Normativa y marco legal

- Estatuto de los Trabajadores (Real Decreto Legislativo 2/2015), especialmente arts. 20 y 64.4.d (modificado por la Ley 12/2021).

- Reglamento General de Protección de Datos (UE) 2016/679.

- Ley Orgánica 3/2018 de Protección de Datos Personales y garantía de los derechos digitales.

- Ley 31/1995.

- Reglamento de Inteligencia Artificial.

- Directiva (UE) 2024/2831.

- Ley 10/2021.

Documentación institucional y guías oficiales

- Ministerio de Trabajo y Economía Social – Guía sobre información algorítmica en el ámbito laboral.

- Instituto Nacional de Seguridad y Salud en el Trabajo – fichas y materiales sobre riesgos psicosociales, carga mental y salud laboral.

- Agencia Española de Protección de Datos – criterios, guías y resoluciones sobre control digital, decisiones automatizadas y DPIA.

- Servicio Público de Empleo Estatal – análisis sobre IA y mercado laboral.

- Estrategia Nacional de Inteligencia Artificial (ENIA) y Agenda España Digital 2026.

Análisis jurídico, doctrinal y profesional

- Garrigues, CMS, ECIJA, Oleart Abogados, CE Consulting, Legalia – análisis sobre IA, RGPD y relaciones laborales.

- AEDTSS (Asociación Española de Derecho del Trabajo y de la Seguridad Social) – estudios sobre transparencia algorítmica.

- Personio, Woffu, MetricsOn, Insight DPD – guías prácticas sobre RGPD, IA y entorno laboral.

- Estudios académicos (UOC, Universidad del País Vasco, UNIR) sobre IA, PRL y organización del trabajo.

Guías sindicales y análisis social

- Comisiones Obreras – Guía sobre gestión algorítmica.

- Unión General de Trabajadores – materiales sobre digitalización, IA y riesgos laborales.

Casos reales y práctica empresarial

- Resoluciones y expedientes de la Agencia Española de Protección de Datos (2023–2026) sobre vigilancia digital, IA en selección y monitorización de empleados.

- Actuaciones y campañas de la Inspección de Trabajo y Seguridad Social sobre uso de algoritmos en empresa.

- Análisis doctrinal y medios especializados sobre jurisprudencia laboral relacionada con automatización y gestión algorítmica.

Tecnología y uso real en empresa

- Herramientas de workforce management y gestión de turnos: Orquest, Tamigo, Sesame HR, DECIDE (MoreOptimal).

- Estudios sobre uso de IA generativa en empresas españolas (Capterra, RRHHDigital, informes sectoriales).

- Informes europeos (EU-OSHA) sobre gestión algorítmica del trabajo.

Nota metodológica

Este artículo se basa en un análisis combinado de normativa vigente, guías institucionales, estudios académicos, documentación técnica y observación directa de la implantación de tecnología en entornos reales de trabajo (retail, hostelería, logística y servicios).

El enfoque no es únicamente jurídico.

Se integra una lectura operativa del uso real de algoritmos, sistemas de control digital e inteligencia artificial en la gestión de empleados, contrastando lo que establece la normativa con cómo se están implantando estas soluciones en la práctica empresarial.

El objetivo no es describir la ley de forma aislada, sino entender cómo impacta en decisiones reales de organización del trabajo, productividad, control y gestión de personas.

Por ello, el análisis combina:

- Marco legal (laboral, protección de datos, PRL y normativa europea de IA)

- Interpretación doctrinal y criterios de autoridades

- Casos reales y tendencias de inspección

- Experiencia práctica en implantación y operativa de punto de venta

Este enfoque permite identificar no solo qué dice la normativa, sino dónde se están produciendo los principales desajustes entre tecnología, empresa y derechos laborales.